- Bạn đọc gửi câu chuyện thật của bản thân hoặc người mình biết nếu được cho phép, không sáng tác hoặc lấy từ nguồn khác và hoàn toàn chịu trách nhiệm trước pháp luật về bản quyền của mình.

- Nội dung về các vấn đề gia đình: vợ chồng, con cái, mẹ chồng-nàng dâu... TTOL bảo mật thông tin, biên tập nội dung nếu cần.

- Bạn được: độc giả hoặc chuyên gia lắng nghe, tư vấn, tháo gỡ.

- Mục này không có nhuận bút.

Hiểm họa từ ảnh khiêu dâm do AI tạo ra

Các công ty AI có thể chặn từ khoá đầu vào hoặc làm mờ hình ảnh đầu ra, nhưng không thể ngăn AI tạo hình ảnh phản cảm vì cách "học" của các của mô hình vẫn là bí ẩn.

Nếu người dùng đưa ra các từ "nhau thai", "ống dẫn trứng", "tuyến vú", "tinh trùng", "tử cung", "niệu đạo", "cổ tử cung", "màng trinh" hoặc "âm hộ", AI sẽ không nhận lệnh và người dùng có thể bị chặn trong một khoảng thời gian. Đây là cách công ty Midjourney ngăn chặn AI cùng tên của họ tạo ra các hình ảnh khiêu dâm hoặc kinh dị về cơ thể con người, theo phát hiện của MIT Technology Review.

Người sáng lập Midjourney, David Holz, cho biết đây là biện pháp tạm thời trong khi tìm cách “cải thiện AI”. Công ty có một trang nguyên tắc cộng đồng liệt kê các dạng nội dung sẽ bị chặn đầu vào, bao gồm hình ảnh khiêu dâm, máu me và thậm chí cả biểu tượng cảm xúc quả đào, thường được sử dụng để ám chỉ mông.

Các AI “khó bảo”

Để đào tạo các mô hình lớn, cần những tập dữ liệu khổng lồ. Các mô hình AI tạo ảnh như Midjourney, Stable Diffusion của Stability.AI hay DALL-E 2 của OpenAI được đào tạo dựa trên hàng tỷ hình ảnh được thu thập từ Internet.

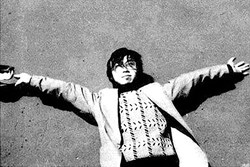

Các AI tạo ảnh có xu hướng tình dục hóa người dùng nữ, do thành kiến từ dữ liệu hình ảnh Internet. Ảnh: MIT Technology Review.

Các AI tạo ảnh có xu hướng tình dục hóa người dùng nữ, do thành kiến từ dữ liệu hình ảnh Internet. Ảnh: MIT Technology Review.

Lượng dữ liệu quá lớn khiến các công ty không thể lọc ra những hình ảnh không mong muốn, chẳng hạn như tình dục hoặc bạo lực. Hình ảnh xuất hiện trong tập dữ liệu càng thường xuyên thì càng có nhiều khả năng xuất hiện trong hình ảnh đầu ra.

Các lệnh cấm từ khóa của Midjourney là một biện pháp tạm thời để ngăn AI tạo ra hình ảnh phản cảm. Dù vậy, người dùng có thể lách luật bằng cách sử dụng các cách viết khác nhau của một từ hoặc dùng cách diễn đạt khác cho nội dung khiêu dâm hoặc đẫm máu, theo Julia Rockwell, nhà phân tích dữ liệu lâm sàng tại Datafy Clinical.

Chuyên gia cho biết với AI Midjourney, cụm từ “khám phụ khoa”, sử dụng cách đánh vần của người Anh là “gynaecological exam”, đã tạo ra những hình ảnh rùng rợn - phụ nữ khỏa thân trong phòng khám với cơ thể kỳ lạ. Rockwell thừa nhận các kết quả này cho thấy xu hướng các hệ thống trí tuệ nhân tạo tình dục hóa phụ nữ, đến cả các cơ quan nội tạng.

Hình ảnh do AI Midjourney tạo ra với từ khóa "gynaecology exam". Ảnh: Julia Rockwell.

Hình ảnh do AI Midjourney tạo ra với từ khóa "gynaecology exam". Ảnh: Julia Rockwell.

Tương tự như Midjourney, Stability.AI và OpenAI cũng phải dùng các "bộ lọc đầu vào", tự động loại bỏ các từ liên quan đến tình dục và bạo lực trước khi đưa yêu cầu của người dùng cho AI. Stability.AI cho biết mô hình mới nhất của họ có thêm "bộ lọc đầu ra", phát hiện và tự động làm mờ các hình ảnh khỏa thân mà AI tạo ra.

Thay vì giải quyết gốc rễ vấn đề, làm cho AI hoạt động một cách an toàn hơn và không đưa ra nội dung phản cảm kể cả khi được cho các từ khóa về sinh học con người, các công ty AI hàng đầu đều phải tìm đến các giải pháp chặn từ khóa và làm mờ hình ảnh.

Chưa có giải pháp khác

Các nhà phát triển và nhà nghiên cứu AI chưa biết cách kiểm tra và cải thiện mô hình của họ một cách có hệ thống, vì vậy họ "vá lỗi" bằng cách cấm một số từ khóa, Marzyeh Ghassemi, nhà nghiên cứu học máy tại MIT, cho biết.

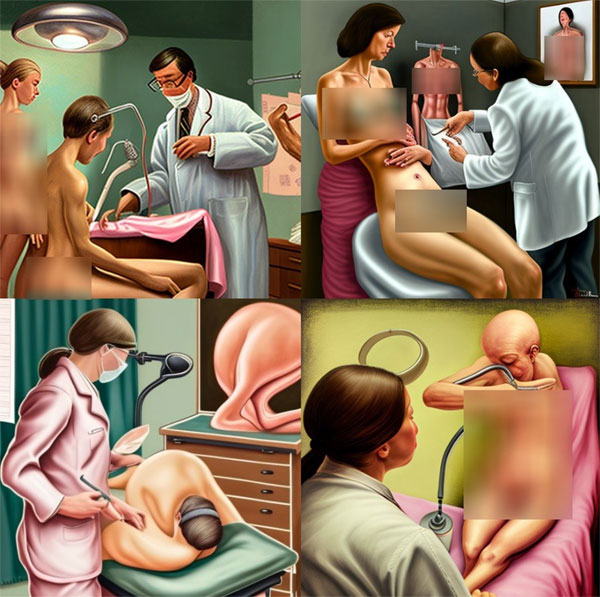

Đến nay vẫn chưa rõ tại sao các nội dung đề cập đến khám phụ khoa hoặc nhau thai, một cơ quan phát triển trong quá trình mang thai và cung cấp oxy cũng như chất dinh dưỡng cho em bé, lại tạo ra nội dung đẫm máu hoặc khiêu dâm. Nguyên nhân có thể xuất phát từ các liên hệ hình ảnh mà mô hình học được trong tập dữ liệu dùng để đào tạo, Irene Chen, nhà nghiên cứu máy học tại Microsoft Research, dự đoán.

Hình ảnh do Stable Diffusion tạo ra khi được cho từ khóa "gynaecology exam". Ảnh: Melissa Heikkilä.

Hình ảnh do Stable Diffusion tạo ra khi được cho từ khóa "gynaecology exam". Ảnh: Melissa Heikkilä.

“Cần nghiên cứu thêm về việc mô hình AI học được những liên hệ có hại hoặc sai sự thật nào trong dữ liệu, bởi vì nếu đào tạo mô hình bằng dữ liệu từ con người, chắc chắn trong dữ liệu sẽ có những thành kiến", Ghassemi nói.

Chuyên gia cho biết giải pháp trước mắt vẫn chỉ là chặn các từ khóa dẫn đến nội dung phản cảm, tuy nhiên có thể chặn theo ngữ cảnh. Chẳng hạn, từ khóa "nhau thai" hoặc liên quan đến sinh học con người sẽ bị chặn nếu yêu cầu đầu vào tìm cách tạo nội dung khiêu dâm hoặc kinh dị, nhưng được cho phép nếu yêu cầu nằm trong ngữ cảnh giáo dục hoặc nghiên cứu.

Dù thô sơ, các biện pháp vá lỗi tạm thời này là cần thiết. “Những rào cản này nhằm bảo vệ phụ nữ và các nhóm thiểu số khỏi những nội dung gây phiền nhiễu được tạo ra về họ", Ghassemi cho biết.

Theo Zing

-

Thế giới1 giờ trướcKết quả xét nghiệm ADN đảo ngược bất ngờ khiến cho người cha vô cùng hối hận.

-

Thế giới1 giờ trướcĐó là loại cây gì?

-

Thế giới8 giờ trướcVụ tai nạn xảy ra là do nạn nhân đã làm một hành động sai lầm khi đi thang máy và đây cũng là lời cảnh báo cho những người khác khi đi thang máy.

-

Thế giới17 giờ trướcTheo người bạn thân Amaia Arrieta, Kate và William đang có một khoảng thời gian vô cùng khó khăn.

-

Thế giới19 giờ trướcTRUNG QUỐC - Một nữ nghệ sĩ xiếc tử vong vì sự cố sân khấu tại lễ hội ở thành phố Hạ Môn, tỉnh Phúc Kiến.

-

Thế giới1 ngày trướcNam thanh niên Trung Quốc bị cảnh sát bắt giữ sau khi cố tình đưa 700.000 nhân dân tệ (2,4 tỷ đồng) tiền giả để đáp ứng yêu cầu mua căn hộ chung cư của vợ sắp cưới.

-

Thế giới1 ngày trướcNhà thiết kế trang phục cho nhà Wales, đồng thời là người bạn của Kate Middleton cho rằng vợ chồng William và Kate như "đang trải qua địa ngục trần gian"